Générateur de voix ia : comment transformer votre texte en paroles naturelles

La synthèse vocale a franchi un cap décisif : les générateurs de voix IA transforment désormais un texte en paroles qui sonnent véritablement naturelles, avec intonations, pauses et émotions. Pour les créateurs de contenu, les formateurs et les studios indépendants, cette évolution ouvre des voies rapides vers la production audio professionnelle sans contrainte d’enregistrement. En 2026, l’offre gratuite permet de tester des voix variées, de la narration chaleureuse pour un livre audio à la voix dynamique d’un agent conversationnel, tout en conservant la possibilité de monter en qualité pour des usages commerciaux. Le panorama comprend des solutions accessibles en ligne, des modèles prenant en charge des centaines de voix et des dizaines de langues, ainsi que des outils qui intègrent prosodie, SSML et effets sonores pour un rendu riche et nuancé.

Dans ce contexte, un studio fictif nommé VoxLab illustre le potentiel réel de ces services : en quelques minutes, il passe d’un script brut à une maquette audio convaincante, puis affine l’intonation et les pauses pour obtenir un rendu adapté à une cible précise. Cet article décrit les principes techniques sous-jacents, propose des critères de sélection des meilleurs générateurs gratuits en 2026, présente un guide pratique pour convertir efficacement du texte en parole et explique comment intégrer ces voix IA dans des workflows professionnels. Chaque section fournit des exemples concrets, des cas d’usage et des recommandations opérationnelles pour que vous puissiez exploiter immédiatement la synthèse vocale neuronale au service de vos projets.

Sommaire:

Générateur de voix IA : principes de la synthèse vocale neuronale et fonctionnement

La synthèse vocale neuronale repose sur des modèles entraînés sur de grandes quantités de données audio et textuelles, capables de capturer les caractéristiques prosodiques d’une langue. Ces modèles apprennent à associer des séquences de phonèmes ou de caractères à des enveloppes sonores, puis utilisent des réseaux neuronaux pour prédire l’énergie, la fréquence fondamentale et les formants nécessaires à une parole naturelle.

La chaîne de traitement se décompose en plusieurs étapes claires. D’abord, un prétraitement transforme le texte en une représentation phonétique et linguistique. Ensuite, un module de prosodie définit la vitesse, l’accentuation et les intonations. Enfin, un synthétiseur génère l’onde audio à partir de ces paramètres. Les approches récentes combinent modèles autoregressifs, transformeurs et vocodeurs neuronaux pour obtenir une restitution fluide et réaliste.

Comment fonctionne un générateur de voix IA moderne

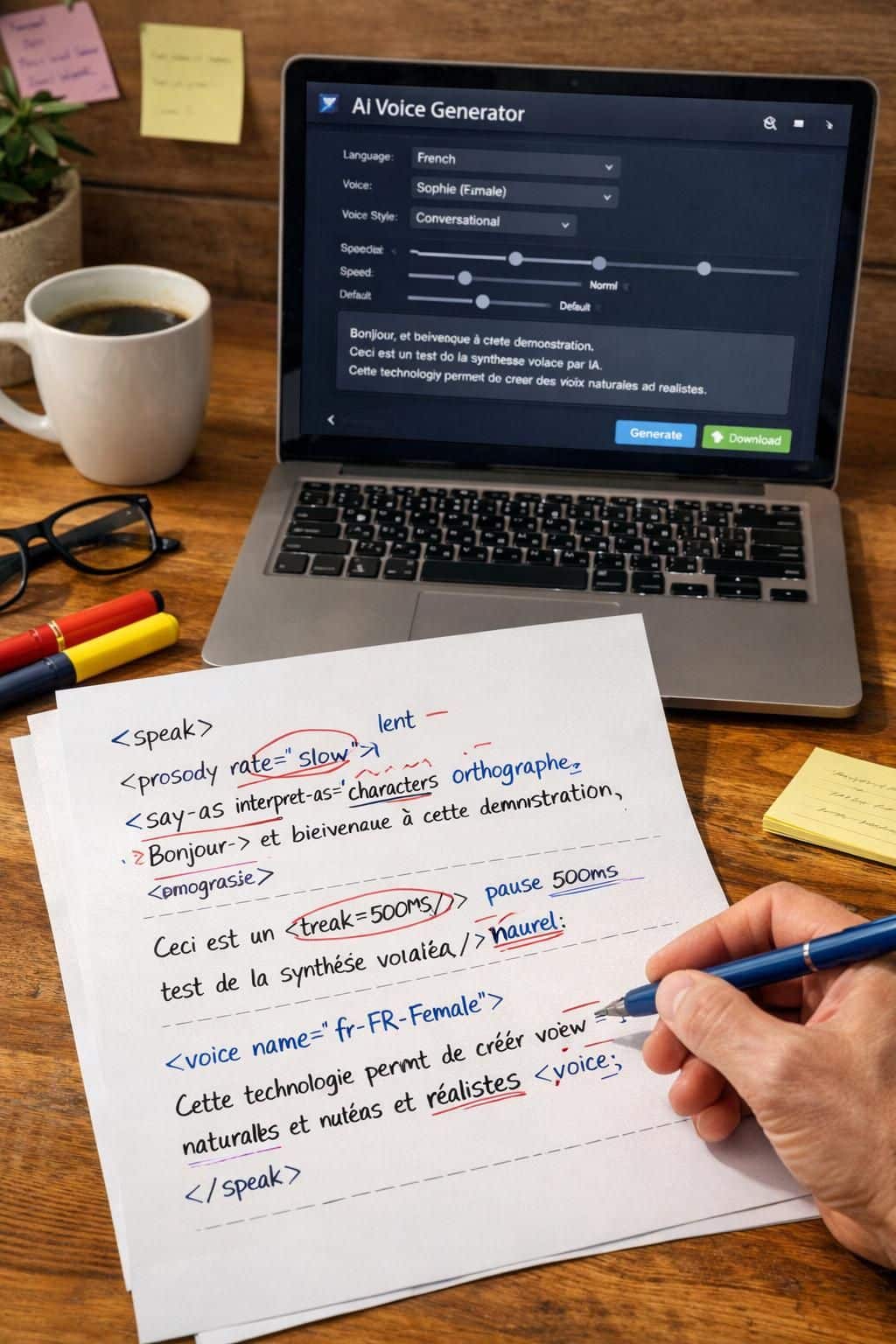

Le prétraitement inclut la normalisation des nombres, la gestion des abréviations et l’annotation des émotions si l’interface le permet. Le moteur de prosodie utilise ces annotations pour choisir le schéma d’intonation. Les algorithmes modernes exploitent des balises SSML (Speech Synthesis Markup Language) ou des équivalents propriétaires pour affiner les pauses et la tonalité.

Le rôle du vocodeur est crucial : il transforme des représentations spectrales en signal audio. Les vocodeurs neuronaux contemporains, tels que WaveNet, WaveGlow et leurs successeurs optimisés, offrent une densité de détail qui restitue des micro-variations humaines comme les inflexions et les respirations. Cette restitution rend l’écoute plus naturelle et évite l’effet « robotique » qui marquait les générations précédentes de TTS.

Cas pratique : comment VoxLab produit une narration convaincante

VoxLab prépare un script de 800 mots destiné à un livre audio jeunesse. Lors du prétraitement, l’équipe insère des balises pour indiquer des respirations, des pauses dramatiques et une intonation interrogative dans certaines répliques. Après sélection d’une voix chaleureuse et d’une émotion « douce », le studio génère un premier rendu, puis ajuste la vitesse et les silences entre phrases.

Une itération permet d’éliminer les prononciations approximatives des noms propres et d’ajouter des effets sonores légers. En moins d’une heure, le rendu est suffisamment naturel pour une écoute test auprès d’enfants, qui valident la vivacité et la clarté de la narration. Ce procédé illustre comment la combinaison d’annotations fines et d’un vocodeur performant transforme un texte en une voix crédible.

Enfin, l’intégration d’un module de post-traitement, qui corrige les volumes et applique une légère égalisation, contribue à un résultat homogène prêt pour la diffusion numérique. Insight clé : maîtriser la prosodie et exploiter les balises de contrôle est plus déterminant que de simplement choisir une voix premium.

Choisir le meilleur générateur de voix IA gratuit en 2026 : critères et comparatif

Choisir un générateur gratuit nécessite d’évaluer plusieurs critères : qualité vocale, variété de voix, nombre de langues prises en charge, possibilités de personnalisation, limites du forfait gratuit et respect de la confidentialité. Les offres évoluent rapidement ; certains acteurs proposent plus de 300 voix et plus de 70 langues, tandis que d’autres misent sur des fonctionnalités avancées comme le contrôle fin de la prosodie et la génération d’effets sonores intégrés.

Pour orienter votre choix, voici une liste de critères pratiques et directement exploitables :

- Qualité d’intonation et naturel de la voix

- Nombre de voix et diversité des accents

- Contrôle de la prosodie (SSML ou équivalent)

- Limites du forfait gratuit (durée, nombre de caractères)

- Formats d’export (MP3, WAV, etc.) et compatibilité API

- Respect de la vie privée et possibilité d’utilisation hors ligne

- Fonctionnalités complémentaires : SFX, mixage, doublage labial

Un tableau synthétique aide à comparer rapidement les options sur ces points.

| Outil | Voix disponibles | Langues | Forfait gratuit | Cas d’usage recommandé |

|---|---|---|---|---|

| Noiz AI (exemple) | ~319+ voix | 70+ | Essai gratuit, limites sur longueur | Livres audio, podcasts, doublage |

| Fotor (générateur vocal) | Voix expressives prémium | Plusieurs langues majeures | Générations de base gratuites | Voix-off pour vidéos marketing |

| Musely.ai | Voix naturelles gratuites | Multilingue | Sans inscription pour tests courts | Contenu social et e-learning |

| Voicertool | 300+ voix | 70+ langues | Utilisation illimitée hors ligne pour certaines offres | Accessibilité, narration |

Au-delà du tableau, il est essentiel de considérer la gouvernance des données. En 2026, certaines plateformes offrent des options d’hébergement local ou des forfaits garantissant la non-utilisation des voix générées à des fins d’entraînement. Si vous traitez des contenus sensibles, privilégiez des solutions proposant des garanties contractuelles sur la confidentialité.

Enfin, pensez à la scalabilité : si l’objectif est de produire des centaines d’heures audio, vérifiez les coûts à l’échelle et la possibilité d’automatiser via API. Insight clé : commencez par un essai gratuit pour valider la qualité de prosodie, puis choisissez un forfait ou une solution exportable selon vos volumes.

Transformer votre texte en parole naturelle : guide pas à pas pour la conversion texte‑vers‑parole

La conversion efficace du texte en parole implique une préparation soignée du script, l’utilisation des balises de contrôle et des itérations rapides. Commencez par rédiger un texte lisible à voix haute : privilégiez des phrases courtes, signalez les pauses nécessaires et segmentez le contenu en blocs thématiques. Cette approche facilite l’ajustement de la prosodie et la détection des points d’accentuation.

Étape 1 : nettoyer et annoter le texte. Normalisez les dates, les chiffres et les abréviations. Ajoutez des directives de pause (ex. SSML <break time= »500ms »/>) et des indications d’émotion lorsque la plateforme les accepte. Cette préparation réduit les itérations ultérieures.

Étape 2 : choisir la voix et définir le style

Sélectionnez une voix adaptée au ton du projet. Pour un tutoriel technique, privilégiez une voix claire et posée. Pour un récit jeunesse, optez pour une voix chaleureuse et expressive. Testez plusieurs variations et comparez des extraits de 20 à 40 secondes avant d’engager une version finale.

Étape 3 : ajuster la prosodie et les pauses. Modifiez la vitesse de lecture et l’accentuation des phrases clés. Utilisez la fonction d’aperçu pour écouter les transitions et identifier les coupes artificielles ou les intonations inappropriées.

Étape 4 : post‑production et intégration

Après génération, appliquez un traitement audio simple : normalisation, suppression des respirations excessives et légère égalisation pour améliorer la clarté. Si le texte doit être doublé par des images, synchronisez la piste audio avec la vidéo et corrigez les timings via des coupes fines. Pour des podcasts, intégrez musique et effets sur des pistes séparées afin de conserver la flexibilité.

Exemple concret : VoxLab convertit un module e-learning de 15 minutes en segments de 90 secondes. Chaque segment est annoté avec SSML pour marquer les pauses entre questions et réponses. L’équipe génère plusieurs variantes émotionnelles pour la même section, puis sélectionne la version la plus engageante après tests utilisateurs.

Conseils pratiques : évitez d’abuser des effets, car ils peuvent rendre la parole trop artificielle. Favorisez des itérations courtes et des retours réels d’auditeurs cibles. Insight clé : la qualité perçue dépend autant du script que de l’algorithme ; soignez le contenu écrit pour maximiser le naturel perceptible.

Personnalisation avancée : créer une voix off expressive et réaliste avec IA

La personnalisation avancée va au-delà du simple choix de voix. Elle inclut la modulation émotionnelle, la création de profils vocaux, la synthèse multi-voix pour dialogues et, lorsque l’autorisation existe, la clonage vocal contrôlé. Ces techniques permettent d’obtenir une signature sonore cohérente pour une marque ou un projet créatif.

Pour personnaliser une voix, commencez par définir un « portrait vocal » : âge perçu, tessiture, accent, et traits émotionnels récurrents. Ensuite, utilisez les paramètres de ton, vitesse et intensité fournis par la plateforme pour créer des variantes. Plusieurs outils offrent la possibilité de sauvegarder des presets, ce qui permet d’assurer une consistance entre les épisodes d’un podcast ou les chapitres d’un livre audio.

Clonage vocal et éthique

Le clonage vocal reproduit la voix d’une personne à partir d’échantillons. Il est puissant mais soulève des enjeux éthiques et juridiques. En 2026, les régulations se sont renforcées : la plupart des plateformes exigent l’autorisation explicite du propriétaire de la voix et proposent des contrats encadrant l’utilisation commerciale. Respecter ces règles évite des contentieux coûteux.

Pour un projet de doublage, VoxLab obtient l’accord d’un comédien pour cloner sa voix. L’équipe limite l’usage à des campagnes précises et documente l’autorisation. Le rendu final combine le clone pour certaines prises et une voix synthétique approchante pour les variations, réduisant ainsi la sensation d’artificialité tout en respectant les contraintes légales.

Techniques pour des dialogues crédibles

Construisez des dialogues comme un metteur en scène : attribuez des marques d’intonation et des silences naturels. Alternez les voix et ajustez les volumes pour simuler la proximité ou la distance. Pour la synchronisation labiale, utilisez des outils qui proposent une time-stretching intelligente et un alignement par phonèmes.

Un exemple concret : pour une série courte d’animation, l’équipe crée trois profils vocaux distincts et les associe à des émotions précises. Chaque épisode est généré en mode multi-voix avec ajustement automatique des respirations et des pauses. Le résultat : un dialogue vivant et crédible sans sessions d’enregistrement longues et coûteuses.

Enfin, surveillez la cohérence sur la durée. Les voix synthétiques évoluent lorsque les paramètres ne sont pas uniformes ; conservez des presets et documentez les réglages. Insight clé : la personnalisation avancée permet de créer une identité sonore forte, mais elle exige rigueur, respect des droits et tests répétés auprès de votre audience.

Intégration du générateur de voix IA dans vos projets : workflow, export et optimisation

L’intégration d’une solution TTS dans un workflow professionnel nécessite des choix techniques et organisationnels. Il faut définir des formats de sortie, une pipeline d’automatisation et une stratégie de sauvegarde des rendus pour faciliter les mises à jour. Les API jouent un rôle central pour automatiser la génération et l’export des fichiers audio.

Commencez par standardiser les formats : préférez WAV pour la post-production en studio et MP3 pour la diffusion en ligne. Définissez des conventions de nommage des fichiers et conservez des métadonnées (version du script, voix utilisée, date de génération). Ces précautions facilitent la traçabilité et la gestion des versions.

Mise en place d’un pipeline automatisé

Un pipeline typique comprend : génération via API, vérification QC automatique (contrôle du niveau audio, détection d’erreurs de prononciation via scripts), post-traitement batch (normalisation, compression) et dépôt sur un CDN ou une plateforme LMS. L’automatisation réduit les erreurs manuelles et accélère les cycles de production.

Exemple opérationnel : une plateforme e-learning intègre l’API d’un générateur de voix pour produire des versions audio à la demande en plusieurs langues. Le système détecte les segments modifiés et regénère uniquement les parties concernées, minimisant les coûts et le temps. La qualité est vérifiée par un module de QA automatique qui signale les anomalies pour intervention humaine.

Optimisation et accessibilité

Optimisez vos fichiers pour le support final : réduisez la bande passante sans sacrifier la clarté vocale, ajustez le loudness pour respecter les standards de diffusion et proposez des options de débit binaire selon le canal (mobile, web, streaming). Pour l’accessibilité, ajoutez des transcriptions synchronisées et des métadonnées pour les lecteurs d’écran.

Sur le plan juridique, documentez la provenance des voix, obtenez les licences nécessaires et conservez les autorisations signées. En 2026, les bonnes pratiques incluent la rétention des logs d’usage et la possibilité d’effacer les données d’entraînement liées à des voix humaines sur demande.

Insight clé : une intégration réussie combine automatisation technique, gouvernance des données et tests utilisateurs réguliers afin d’assurer une production scalable et conforme.

Qu’est-ce qu’un générateur de voix IA et comment se distingue-t-il d’un TTS traditionnel ?

Un générateur de voix IA utilise des réseaux neuronaux et des vocodeurs avancés pour restituer intonations et émotions, contrairement aux TTS traditionnels plus monotones. Il intègre souvent des contrôles de prosodie et des balises SSML pour affiner le rendu.

Peut-on utiliser une voix IA gratuitement pour un projet commercial ?

Cela dépend des conditions du fournisseur. De nombreuses plateformes offrent un forfait gratuit pour tests, mais l’utilisation commerciale nécessite souvent une licence payante. Il est essentiel de lire les conditions d’utilisation et d’obtenir les autorisations nécessaires.

Comment améliorer la naturalité d’une voix générée ?

Soignez le script, utilisez des balises de prosodie, choisissez une voix adaptée et réalisez plusieurs itérations en ajustant la vitesse et les pauses. Un post-traitement audio léger contribue également à un rendu plus professionnel.

Le clonage vocal est-il réglementé en 2026 ?

Oui. Depuis 2024-2026, la majorité des plateformes exigent une autorisation explicite pour cloner une voix. Les contrats encadrent l’usage commercial et garantissent des protections juridiques pour les droits vocaux.

Commentaires

Laisser un commentaire